Realtime Speech-to-Speech • On-Premise • Enterprise-ready

Realtime-VoiceAI.

Live-fähig. sicher. Auf deiner Infrastruktur.

Kein SaaS-Bot. Kein Pipeline-Hop. Eine produktionsreife Realtime Speech-to-Speech-Basis — mit voller Datenkontrolle und tiefer Systemintegration.

● Realtime-VoiceAI • Call Monitor

Entwickelt von MayflowerPraxis statt PowerPoint-KI

Open SourceContributors bei LangChain & Hugging Face

Überzeugtu. a. bei ServiceRating

500k gleichzeitige UserSkalierung bewiesen

DAS PROBLEM

Consumer-Voicebots.

Vier Risiken, die keine Demo zeigt.

In vielen SaaS-Voicebots laufen Spracherkennung, Modell-Logik und Sprachsynthese in getrennten Diensten. Das verursacht Latenzen, wirkt unnatürlich und verhindert echte Gesprächsunterbrechungen. Im Enterprise-Umfeld ein K.O.-Kriterium.

Latenz durch STT ➝ LLM ➝ TTS-Ketten

Spracherkennung, Verarbeitung und Synthese laufen getrennt. Das Ergebnis: holprige Dialoge, keine natürliche Prosodie.

Unterbrechungen unmöglich.

Datenabfluss an externe Clouds

Sensible Kundendaten verlassen deine Infrastruktur. Ein großes Problem für regulierte Branchen — kein Audit-Trail, kein Compliance-Nachweis.

Oberflächliche Integration

Standard-APIs reichen nicht für tiefe Prozess-Integration. Workflow-Editoren können komplexe Unternehmenslogik nicht abbilden.

Vendor Lock-in

Abhängigkeit von proprietären Plattformen ohne Auditierbarkeit oder Erweiterungsmöglichkeiten.

WEITERE EINSCHRÄNKUNGEN

DIE LÖSUNG

Viele Herausforderungen.

Eine Architektur-Entscheidung.

Consumer-Tempo. Enterprise-Hoheit. Ohne Pipeline-Hop, ohne Datenabfluss, ohne Lock-in.

Mayflower VoiceAI

WEITERE VORTEILE

Überzeugt (nicht nur)

bei Service Rating.

„Wow, ganz vorne mit dabei! Neues VoiceAI-Modell von OpenAI und eine Woche später Demo zum realtime-speech-to-speech-VoiceAI-Agenten von Mayflower im Expertenkreis von ServiceRating. Keine PowerPoint-KI – echte Anrufe, live-Interaktion. Björn hat gezeigt, wie agentische KI heute schon Anliegen autonom löst und Gespräche mit menschlichen Beratern koordiniert.”

– Franz Gresser, ServiceRating

Nur eine von vielen Live-Demos, in denen unsere Enterprise VoiceAI-Lösung überzeugen konnte.

UNTERNEHMENSINTEGRATION

CRM, ERP, Legacy.

Tief integriert, nicht API-gepatcht.

Agentische Anbindung via MCP, Supervisor-Flow für QS, SIP ohne Anlagenwechsel. Kein Inselbetrieb, keine Workflow-Starre.

INTEGRATION

Nahtlose Telefonie-Integration

Kompatibel mit allen gängigen SIP-Systemen: Genesys, Twilio, Avaya, Cisco — ohne Austausch der bestehenden Anlage.

INTELLIGENZ

Agentische Orchestrierung statt Skripte

Die KI greift kontextabhängig auf Systeme zu — nicht über starre Workflows, sondern intelligent und selbstlernend.

KONTROLLE

Supervisor-Flow für Qualitätssicherung

Echtzeit-Transkripte, Live-Monitoring mehrerer Gespräche, Eingriff per Klick — Kontrolle jederzeit gewährleistet.

COMPLIANCE

Compliance & Audit Trails

Jede Aktion ist nachvollziehbar, auditierbar, DSGVO-konform. Kritisch für regulierte Branchen.

SKALIERUNG

Beliebig skalierbar

5 oder 5.000 Anrufe gleichzeitig — die Architektur skaliert. Auch mehrsprachig, ohne Vorkonfiguration.

LERNEN

Automatisches Lernen

Das System analysiert Gespräche und generiert Lernvorschläge — mit oder ohne Supervisor-Freigabe.

BUSINESS VALUE

Kostet weniger. Skaliert weiter. Bleibt im Haus.

Servicequalität, Skalierung, Datenhoheit — in einer Entscheidung.

Servicequalität

↑ NPS

Keine Wartezeiten mehr in der Hotline. Die KI beantwortet Routine-Anfragen sofort, während deine Experten sich auf komplexe Fälle konzentrieren.

Anfragen werden so schneller beantwortet und Aufträge schneller ausgeführt. Die Folge: NPS steigt, First Contact Resolution steigt, AHT sinkt.

Skalierung ohne Recruiting-ENGPASS

500k

Peak-Zeiten, Produktlaunches, Kampagnen – VoiceAI fängt Lastspitzen ab, ohne dass du neues Personal onboarden musst.

Deine Experten werden zu Supervisors, die 4 oder mehr Gespräche gleichzeitig beobachten und bei Bedarf eingreifen.

Datenhoheit & COMPLIANCE

100%

Deine Kundendaten bleiben in deiner Infrastruktur. Keine Blackbox-Modelle, keine ungeklärten Compliance-Fragen.

Das schafft Vertrauen bei Kunden und Aufsichtsbehörden.

EFFIZIENZ & Kostenoptimierung

~80%

Die Zahlen sprechen für sich: VoiceAI-Stunden kosten von ca. 2,80€ bis 4€, verglichen mit 15 € Mindestlohn pro Stunde (Deutschland).

Das sind 80 % Einsparung – bei gleichzeitig höherer Verfügbarkeit und Qualität.

Die Rechnung stimmt. Rechnet sie sich in deinem Setup?

FEATURE-HIGHLIGHTS

Sechs Fähigkeiten, die

keine SaaS-Voice-Plattform mitbringt.

Supervisor-Flow, agentische Integration, Kiosk-Avatare — und alles, was der Audit verlangt.

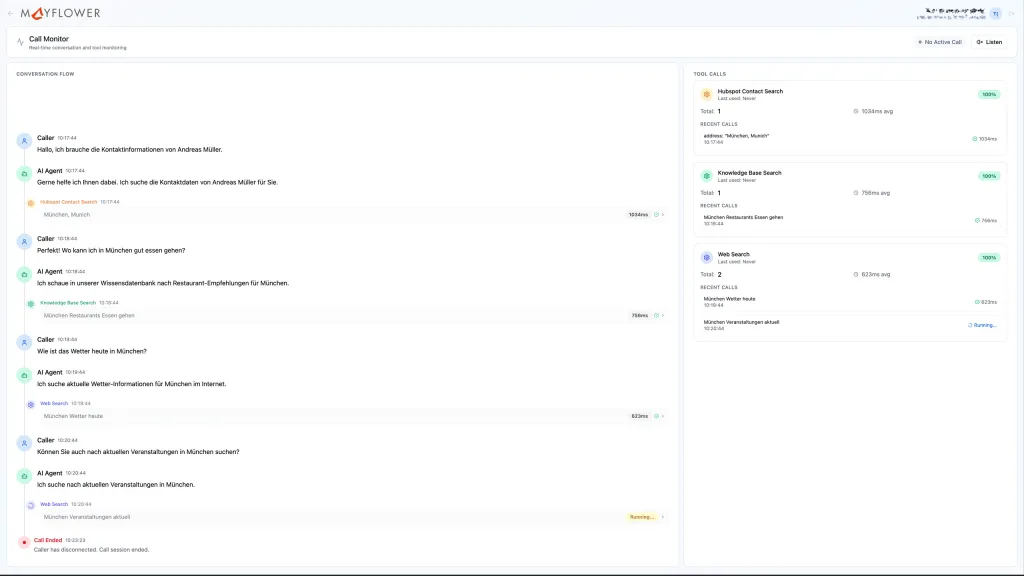

Supervisor-Flow / Multi-Call-Monitor

Gesprächsaufzeichnungen, Live-Transkripte, Anrufgruppen und Eingriff per Klick. So bleibt Kontrolle und Qualitätssicherung jederzeit gewährleistet, während die KI autonom Routineaufgaben übernimmt.

Deine Experten werden zu Supervisors, die mehrere Gespräche beobachten und bei Bedarf in Echtzeit eingreifen.

→ Kontrolle ohne Kontrollverlust

Automatisches Lernen

Das System analysiert die geführten Gespräche und merkt sich die daraus gewonnenen Erkenntnisse. So entstehen übergreifende Lernvorschläge, die alternativ von einem menschlichen Supervisor freigegeben werden können oder, je nach Einstellung, automatisiert ins System übergehen.

→ KI, die besser wird

Mehr als MCP-Support

Echte agentische Integration, selbstlernend, selbstkorrigierend, Compliance & Audit Trails inklusive. Selbst die Integration von Alt-Systemen ist über Leacy-Use möglich. Deine IT-Landschaft (z. B. CRM, ERP, Buchungssysteme u. v. m.) wird über MCP-Tools angebunden und stehen dem Mayflower Enterprise VoiceAI als Tool zur Verfügung.

→ Tiefe, nicht Breite

Omnichannel & Mehrsprachig

Omnikanal-Fähigkeit und Mehrsprachigkeit sorgen für konsistente Erlebnisse – am Telefon, in E-Mails, MS-Teams oder im Chat gleichermaßen.

→ Ein System, alle Kanäle

Outbound & Anrufgruppen

Flexible Anrufgruppen (z. B. Sales Europa, Support DACH), Outbound-Kampagnen inklusive Echtzeit-Sentiment-Analyse und Rückrufaktionen – skalierbar über Unternehmensbereiche hinweg.

→ Auch Outbound

Avatare für Kiosk- / Filiallösungen

Für stationäre Lösungen mit Bildschirmen oder Devices im Kiosk-Mode kann ein vollständig animierter Avatar hinzugefügt werden, der mit dem Nutzenden interagiert.

→ Auch stationär

Für den schnellen Vergleich.

- Gesprächsqualität

- Datenhoheit

- System-Integration

- Telefonie

- Orchestrierung

- Skalierung

- Mehrsprachigkeit

HERKÖMMLICHE

SaaS

LÖSUNGEN

Gesprächsqualität:

⛔ Latenzen und holprige Dialoge durch getrennte STT/LLM/TTS-Ketten- ⛔ Externen Clouds/LLMs,

Vendor Lock-in - ⛔ Standard-APIs, oberflächlich

- ❗ Ausgewählte Telefonanlagen

- ❗ WYSIWYG-Workflows

- ❗ Pro-Seat-Pricing

- ❗ Vorab konfigurieren

MAYFLOWER

VoiceAI

Gesprächsqualität:

✅ Realtime Speech-to-Speech: natürliche Prosodie- ✅ On-Premise / Private Cloud

- ✅ Agentische MCP-Integration

- ✅ Alle gängigen SIP-Systeme

- ✅ Agentisch, selbstlernend

- ✅ Beliebig skalierbar

- ✅ Out-of-the-Box, kontextsensitiv

In 16 Wochen produktiv.

Discovery, PoC mit deinen Daten, Integration, Rollout — in vier Schritten vom Erstgespräch zur Produktion.

Woche 0

Erstgespräch & Discovery

Wir analysieren deine Use Cases, Systemlandschaft und Compliance-Anforderungen. Definition von KPIs und Erfolgskriterien.

Woche 1-4

Proof of Concept mit deinen Daten

VoiceAI-Demo mit deinen realen Prozessen und Systemen. Du siehst live, wie das System in deinem Szenario agiert.

Woche 5-16

Integration &

Training

Anbindung an CRM/ERP/Telefonie via MCP & APIs. Supervisor-Schulung, Konfiguration der Anrufgruppen und Qualitätssicherungs-Flows

FORTLAUFEND

Rollout, Monitoring & Optimierung

Laufendes Monitoring, KI-Tuning auf Basis realer Gespräche, kontinuierliche Erweiterung um neue Kanäle und Funktionen.

WARUM MAYFLOWER?

Mit KI arbeiten heißt für uns,

an KI zu arbeiten.

Wir sind keine KI-Berater, die Folien liefern. Wir sind Engineers, die Systeme in Produktion bringen.

Open-Source-BAISERT

Open-Source-first — mit Substanz

Wir contributen aktiv zu LangChain, vLLM, LLaMa Factory, OpenGPTs, LangChain Anthropic und sind auf Hugging Face vertreten. Das sichert dir Zukunftsfähigkeit, Unabhängigkeit und Auditierbarkeit.

Enterprise-proven

Enterprise-Architekturen statt Bastellösungen

Wir bauen plattformagnostische, hybride Daten- und KI-Architekturen und integrieren KI tief in Kernprozesse — On-Premise oder in deiner Private Cloud. Keine POCs, die nie in Produktion gehen.

Praxis

Praxis statt „PowerPoint-KI”

Produktionsreife KI-Agenten und VoiceAI-Lösungen, die in realen Umgebungen bestehen. Demonstriert bei ServiceRating, Bits & Pretzels und in Live-Calls — nicht nur in Demos.

Expertise AUS DER PRAXIS

Skalierungs-Expertise aus der Praxis

Mit Bits & Pretzels haben wir eine High-Performance-Videoplattform für bis zu 500.000 parallele Teilnehmer gebaut. Wir liefern hochskalierende Use Cases produktionsreif.

Ein Gespräch. Kein Commitment.

30 Minuten. Deine Herausforderung. Ein Architektur-Weg.

Zeig uns deinen Use Case. Wir zeigen dir, wie VoiceAI dort läuft.

Björn Schotte – Geschäftsführer, Mayflower GmbH

Johann-Peter Hartmann – Geschäftsführer, Mayflower GmbH

FAQ